콘텐츠

2019 년 10 월 15 일좋은 카메라가 장착 된 스마트 폰을 찾고 있다면 추천 목록에서 Google의 픽셀 시리즈를 본 적이있을 것입니다. 매년 Google은 매번 훌륭한 결과를 제공하는 카메라를 만드는 방법을 알아 냈습니다. 픽셀 엿보기 기술 블로거에서 일상 소비자에 이르기까지 픽셀의 카메라를 좋아하지 않는 한 사람을 찾기가 어렵습니다.

Google은 카메라를 만들려고하지 않습니다. 마법을 만들고자합니다.

-

- 마크 레보이

-

- 아이작 레이놀즈

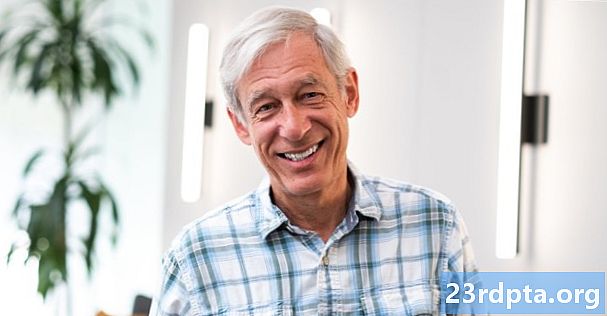

필자는 최근 Pixel 시리즈의 실망스러운 카메라 시스템의 핵심 요소 인 Marc Levoy와 Isaac Reynolds와 함께 앉을 기회를 가졌습니다. 개선 된 Night Sight에서 WYSIWYG (What You See Is What You Get) 실시간 HDR + 뷰 파인더에 이르기까지 Pixel 4 카메라의 새로운 기능에 대해 오랫동안 대화를 나 had습니다. Google이 이러한 기능을 어떻게 활성화하고 있는지에 대한 많은 기술적 인 이야기가 있었지만 결국 한 가지 분명해졌습니다. Google의 픽셀 카메라는 전혀 카메라가되지 않습니다.

레이놀즈는“우리의 핵심 철학은 마술을하는 카메라를 만드는 것입니다. 즉, 단순성과 이미지 품질의 조합입니다.”라고 밤에 시력은 여전히 존재하지만 기본 HDR +는 여전히 존재합니다. 기본 모드에서 멋진 사진을 얻기 위해 후드 아래에서 진행되는 모든 처리가 여전히 있습니다. 또한 실제로 훨씬 더 단순화했습니다.”

기본 모드. 단순화. 마법. Google에서 Pixel 카메라의 핵심 철학의 일부로 사용하고있는 문구입니다. Levoy와 Reynold의 마음에서 순간을 포착하는 것이 모드 다이얼과 설정 메뉴에 관한 것일 필요는 없습니다.Google은 휴대 전화에 카메라를 만들려고하지 않고, 전통적인 방법이나 다른 방법을 통해 게이트 밖으로 지속적으로 멋진 이미지를 만드는 것을 만들려고합니다.

당신이 보는 것은 당신이 얻는 것입니다

![]()

Pixel 4의 새로운 기능 중 하나는 WYSIWYG 뷰 파인더입니다. 즉, 촬영하기 전에 HDR +의 결과를 볼 수 있습니다. 이것은 사소한 기능처럼 보일 수 있지만 계산 방식이 아닌 카메라에서는 불가능했던 것들을 가능하게합니다.

WYSIWYG 뷰 파인더의 목표는 가능한 한 사용자 상호 작용을 줄이는 것입니다. 카메라를 열 때 바로 결과 이미지를 보여줌으로써 즉시 고르게 노출되는지 알 수 있으며 촬영에 집중할 수 있습니다.

"사용자가 도청 한 것을 본다면 카메라가 처음부터 원하는 것을 제공하지 않았다는 것을 알고 있습니다."라고 Reynolds는 말합니다.“저에게 탭은 잠재적으로 우리가 개선하고 싶은 실패 사례입니다 ”

기존의 카메라 시스템은 카메라에서 직접 원하는 이미지를 얻는 데 상당히 나쁩니다. 하이라이트를 노출하고 나중에 그림자를 올리거나 그림자를 노출하지만 하이라이트를 날려 버릴 수 있습니다. 기술 덕분에 우리는 두 가지를 모두 할 수 있으며 이것이 바로 컴퓨터 사진이 마술을 일으키기 시작하는 곳입니다.

"WYSIWYG 뷰 파인더를 사용하면 원하는 경우 카메라의 노출을 제어하는 방법을 다시 생각할 수 있습니다."라고 Levoy는 말합니다. "누르면 노출 보정 슬라이더를 얻기 전에 두 개를 얻게됩니다. 슬라이더. 이 기능을 이중 노출 제어라고합니다. 그리고 그것은 하이라이트와 그림자 일 수 있습니다. 밝기와 다이나믹 레인지 일 수 있습니다. 이 두 가지 변수를 수행 할 수있는 방법이 많이 있습니다. 밝기와 그림자가되도록 설정했습니다. 이는 이전에는 아무도 카메라를 사용해 본 적이없는 일종의 제어 기능을 제공합니다.”

사진을 찍기 전에 사진을 편집하고 있습니다.

Levoy가 옳습니다. 이중 노출 제어는 전산 이미징을 통해서만 생성 할 수있는 것입니다. 기준선으로서, 하이라이트와 가시 그림자가 보존되어 이미지가 고르게됩니다. 그러나 원하는 경우 사진을 찍기 전에 하이라이트와 그림자를 개별적으로 조정할 수 있습니다. 그것은 사진을 찍은 후에 사진 편집 소프트웨어에서만 가능했던 일입니다.

Levoy의 팀은 기존 카메라의 한계에 중점을 두어 기존 카메라의 한계를 극복하려고 노력하고 있습니다. 대부분의 제조업체는 조리개, 셔터 속도 및 ISO를 제어 할 수있는 Pro 모드를 도입하고 있지만 Google은 노브를 올바르게 사용하더라도 자동으로 더 나은 이미지를 만들려고 노력하고 있습니다.

학습으로 죽여라

![]()

그렇다면 기존의 카메라 기술을 능가하는 다른 방법은 무엇입니까? 올해 Levoy의 팀은 저조도 문제를 해결하고 있습니다.

Pixel 4는 학습 기반 화이트 밸런스를 카메라 시스템에 도입하고 있습니다. 이 기능은 매우 나쁜 조명에서도 이미지의 색상을 지속적으로 향상시킵니다. Google은 구체적으로 저 조명 및 노랑 광을 목표로하고 있으며 고치고 자하는 예로 Sodium Vapor light를 사용했지만 매번 완벽한 화이트 밸런스를 목표로하고 있습니다.

나트륨 증기 램프는 589nm ~ 589.3nm의 매우 좁은 파장으로 인해 피사체에 거의 흑백 효과를주는 가스 램프 유형입니다. 그것들은 매우 효율적인 광원이기 때문에 사용되기 때문에 가로등이나 오래 지속되어야하는 다른 조명에서 종종 볼 수 있습니다. 정확한 화이트 밸런스를 얻는 것이 가장 어려운 상황 중 하나이므로 Google의 소프트웨어 수정은 정말 인상적입니다.

Levoy는“나트륨 수증기 빛의 경우 황색 일 것이고, 우리는 그 나쁜 조명을 중화하려고 노력할 것입니다. "낮은 조명에서 많이 발생합니다. 디스코에 들어가서 붉은 네온 불빛이 있다면, 그것을 보존하지만 불리한 지역 조명을 중화하려고 시도 할 것입니다.”

학습 기반 화이트 밸런스는 이미 Google의 Night Sight 모드에 있었기 때문에 Huawei P30 Pro의 자동 모드보다 최종 이미지의 색상이 훨씬 우수합니다. 이 시스템은 균형이 잘 잡힌 것으로 간주되는 장치에서 촬영 한 이미지를 기반으로 학습하고, 조명이 어두운 환경에서 학습 된 데이터를 사용하여 더 정확한 색상의 이미지를 생성합니다. 이것은 전통적인 카메라 시스템으로는 할 수없는 일입니다. 카메라가 배송되면 자동 화이트 밸런스는 자동 화이트 밸런스입니다. Pixel에서는 시간이 지남에 따라 더 나아지기 위해 항상 노력하고 있습니다.

학습 기반 화이트 밸런스는 저조도 이미지를 훨씬 더 쉽게 만들어 주지만 Levoy는 컴퓨터를 사용하여 한 번 어려운 형태의 천체 사진을 단순화하려고합니다.

별을 봐

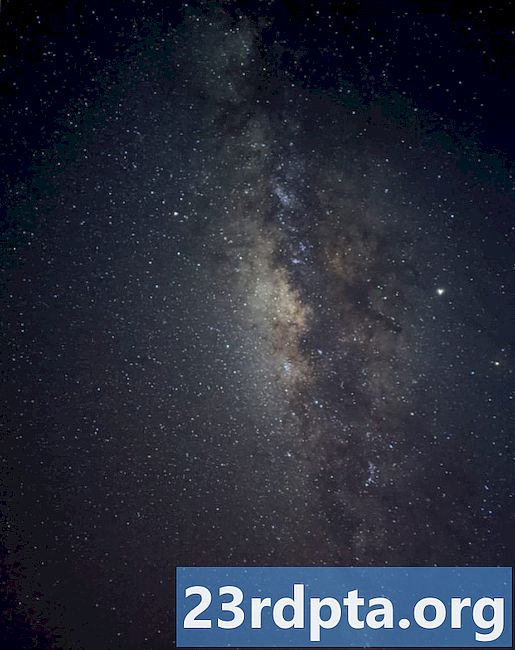

출처 : Google

Levoy는이 새로운 기능을 "스테로이드에 대한 HDR +"라고합니다. 표준 HDR +는 10-15 개의 단시간 노출을 촬영하고 저잡음으로 선명한 이미지를 얻기 위해 정렬하고 평균을 측정하는 경우이 새로운 모드는 최대 15 초의 16 초 노출을 사용하여 4 분 노출을 만듭니다. 그런 다음 시스템은 이미지가 정렬되고 (별이 시간이 지남에 따라 이동하므로) 적절한 설정을 조정하면서 픽셀 평균으로 노이즈를 줄이면서 놀라운 이미지를 만듭니다.

이것은 나를위한 성배였습니다.

마크 레보이Levoy는 그의 팀이 은하수를 찍은 사진의 몇 가지 예를 보여 주었고, 내 턱은 문자 그대로 떨어졌습니다. 기존의 카메라 시스템에서 장시간 노출이 가능하지만,보다 선명한 이미지를 원하면 일반적으로 시간이 지남에 따라 카메라를 돌리기위한 추가 장비가 필요합니다. Night Sight를 사용하면 휴대 전화를 바위에 대고 셔터를 누르면 장치가 나머지 작업을 수행 할 수 있습니다.

이 새로운 Astro Night Sight 모드의 가장 똑똑한 부분은 별도의 모드가 아니라는 것입니다. 모든 것은 Night Sight 버튼으로 발생합니다. HDR +는 이미 자이로 스코프를 사용하여 움직임을 감지하고 이미지의 버스트를 정렬합니다. Night Sight는 이제 셔터 버튼을 눌렀을 때 장치가 최대 4 분 동안 얼마나 안정적인지에 따라 이미지를 촬영할 수있는 시간을 감지합니다. 또한 시맨틱 세분화 (Semantic Segmentation)라는 방법을 사용하여 하늘을 감지하여 시스템이 최상의 결과를 위해 이미지의 특정 영역을 다르게 처리 할 수있게합니다.

-

- 출처 : Google

-

- 출처 : Google

Reynolds는 다음과 같이 말합니다. "우리는 누구나 쉽게 사용할 수 있기를 원합니다. 따라서 제품에서 필요하지 않은 제품을 찾을 때마다 해당 책임을 귀하로부터 멀리하고 해결할 수 있습니다."

이 진술은 구글이 픽셀의 카메라로하려고하는 것을 진정으로 보여줍니다. Google은 카메라처럼 카메라를 작동시킬 수있는 방법을 찾는 대신 기존에 몰랐던 문제를 해결하고 가능한 가장 간단한 형태로 제시하려고합니다.

물론 양쪽에는 장점이 있습니다. 어떤 사람들은 결핍, 필요 수동 컨트롤과 다이얼이있는 카메라처럼 작동하는 폰 카메라. 더 큰 센서와 Pro 모드를 원할 수도 있습니다. 그러나 다른 ODM은 거의 하드웨어에만 초점을 맞추고 있지만 Google은 완전히 다른 방향을 찾고 있습니다.

마법을 찾고 있습니다.

컴퓨터 사진에 대해 더 자세히 알고 싶으십니까? 위의 비디오를 확인하여이 필드가 어떻게 이미지를 만드는 방식을 바꾸는 지 확인하십시오.

픽셀 4